Fotoğraf paylaşım platformu Instagram, estetik operasyonla ilişkili bütün artırılmış gerçeklik (AR) filtrelerini kaldıracağını açıkladı. Bu filtrelerin insanların akıl ve ruh sağlığına zarar vermesinden endişe ediliyor.

BBC Türkçe'de yer alan habere göre, Bir araştırmaya göre yüzleri değiştiren filtreler insanların görünümleriyle ilgili olumsuz hissetmelerine yol açabiliyor.

“Politikalarımızı gözden geçirdik”

Instagram'ın sahibi olan Facebook, yaptığı duyuruda bu adımın insanların akıl ve ruh sağlığını korumak için atıldığını belirtti. Şirket sözcüsü yaptığı açıklamada, politikalarını gözden geçirdiklerini, insanların filtreleri aracılığıyla kendilerini iyi hissetmelerini istediklerini söyledi.

“Estetikle ilişkili filtrelerin onay süreci durdurulacak”

Bu süreç boyunca da estetik operasyon ile ilişkili bütün filtrelerin kaldırılacağı, bu filtrelere dair onay sürecinin durdurulacağı ve bu yöndeki yeni efektlerin uygulamaya girmeyeceği belirtildi. Ağustos ayında yapılan bir güncelleme ile Instagram kullanıcılarının kendi görsel efektlerini yaratmasına izin vermişti. Plastica gibi çok sayıda popüler filtre, estetik operasyonların aşırı etkilerini insanların yüzlerine uyguluyordu.

“Aslında bir estetik müdahale eleştirisi getiren bir uygulama”

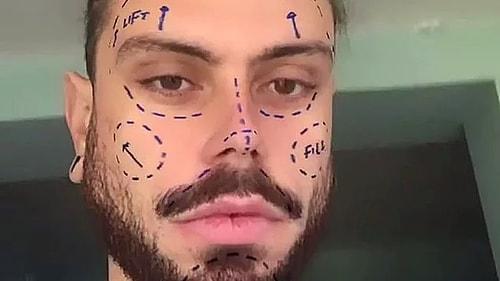

FixMe adındaki filtre ise bir estetik cerrahın hastasının yüzünde nasıl işaretlemeler yaptığını gösteriyor. Bu filtrenin yaratıcısı Daniel Mooney yaptığı açıklamada, FixMe'nin aslında bir estetik müdahale eleştirisi getiren bir uygulama olduğunu, bu sürecin işaretlemeler ve morluklarla insanı olumsuz bir görünüme soktuğunu göstermek istediğini söyledi. Mooney, amacının 'mükkemmel bir görüntü' yaratmak olmadığını, tam tersine 'mükemmeliğin' çok abartılan bir şey olduğunu göstermek istediğini ifade etti.

“Çok sayıdaki hesap estetik operasyon yaptırmış insanlardan oluşuyor”

Mooney aynı zamanda Instagram'da takip edilen çok sayıdaki hesabın estetik operasyon yaptırmış insanlardan oluştuğunu, o yüzden bu filtreleri kaldırmanın çok da bir işe yaramayacağını belirtti. Şubat ayında Instagram, insanların kendilerine zarar verdiğini gösteren bütün görselleri platformdan kaldıracaklarını açıklamıştı; bunun gençleri ve hassas ve kırılgan insanları zora sokabileceğini söylemişti. Bu karar 2017 yılında 14 yaşındaki Molly Russell'ın Instagram'da bu şekildeki görüntüleri gördükten sonra intihar etmesinin ardından gelmişti.